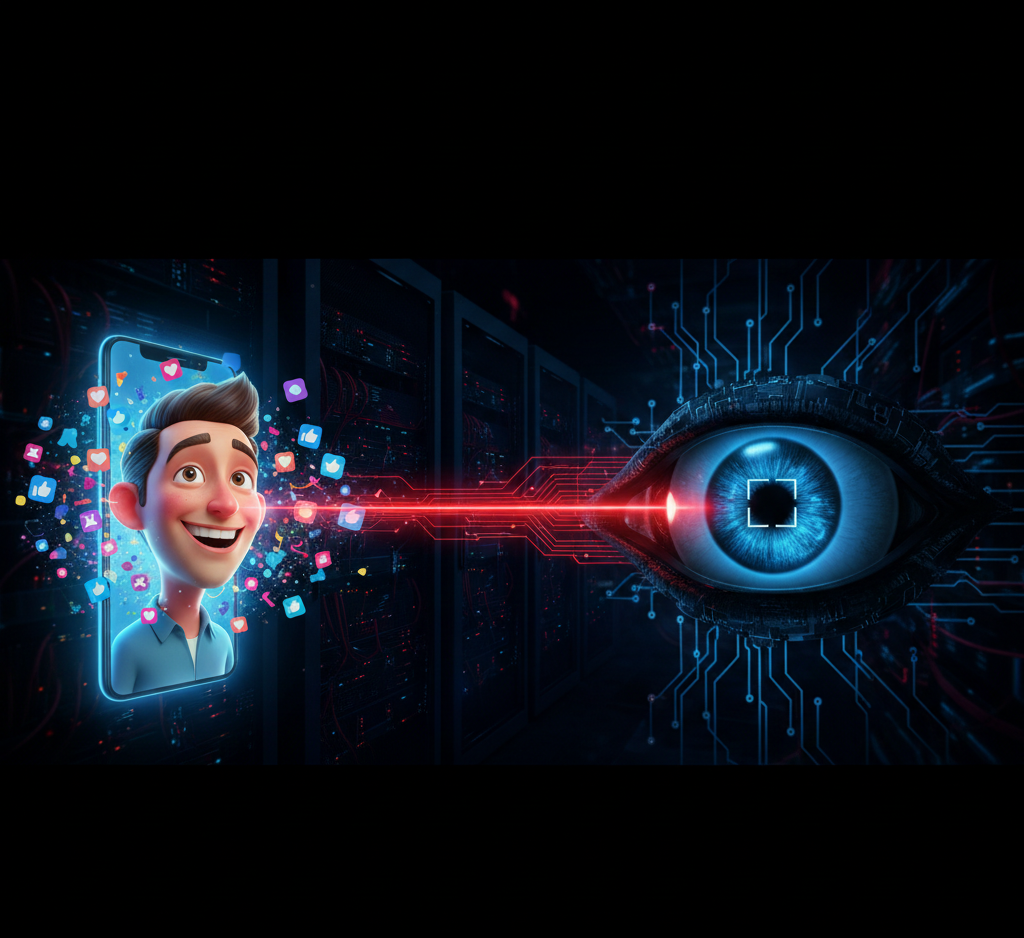

تصدّر تريند الكاريكاتير بالذكاء الاصطناعي مواقع التواصل الاجتماعي، بعدما لجأ آلاف المستخدمين إلى أدوات تعتمد على ChatGPT وتقنيات مشابهة لتحويل صورهم الشخصية إلى رسومات كاريكاتيرية أو تحليل شخصياتهم ووظائفهم، ورغم الطابع الترفيهي لهذا التريند، يحذّر خبراء تكنولوجيا وأمن معلومات من مخاطر حقيقية تتعلق بالخصوصية والأمان الرقمي وسوء استخدام البيانات الشخصية، فهل سألت نفسك، أين تذهب هذه الصور بعد معالجتها؟ ولماذا يرتفع صوت التحذيرات من قبل خبراء التكنولوجيا بالتزامن مع كل “تريند” جديد؟

ما هو تريند الكاريكاتير

تريند الكاريكاتير هو ظاهرة حديثة على مواقع التواصل الاجتماعي، تعتمد على استخدام أدوات الذكاء الاصطناعي، مثل ChatGPT أو تطبيقات متخصصة، لتحويل صور الأشخاص إلى رسومات كاريكاتيرية أو لتحليل شخصياتهم وصفات أعمالهم بشكل مرئي.

في حقيقة الأمر جربت التريند شخصياً وصراحة ندمت، وبشكل بسيط نقوم بالتالي:

- رفع صورة شخصية للشخص حقيقية على نموذج شات جي بي تي أو أي روبوت دردشة للذكاء الاصطناعي.

- بعد رفع الصورة، نكتب عبارة بالعربية أو الإنجليزية مثل (“Create a caricature of me and my job based on everything you know about me.”)

- تعالجها أداة الذكاء الاصطناعي، فتنتج صورة كاريكاتيرية أو تعطي وصفًا لشخصيته.

- يشارك المستخدم النتيجة على السوشيال ميديا، ما يجعل التريند ينتشر بسرعة بين آلاف المستخدمين.

- رغم الطابع الترفيهي والمرح، يحمل تريند الكاريكاتير مخاطر تتعلق بالخصوصية والأمان الرقمي، لأنه يعتمد على جمع البيانات الشخصية والصور، والتي يمكن أن تُستخدم لاحقًا لأغراض التحليل أو الانتحال أو حتى التسويق، دون ضمانات واضحة.

كيف يعمل تريند الكاريكاتير؟

يعتمد التريند على قيام المستخدم برفع صورته الشخصية إلى تطبيقات أو أدوات ذكاء اصطناعي، تقوم بتحليل ملامح الوجه وتحويلها إلى صورة كاريكاتيرية أو تقديم وصف للشخصية وطبيعة العمل. هذه العملية، التي تبدو بسيطة وسريعة، تخفي في طياتها استخدامًا واسعًا للبيانات البيومترية، وهي من أكثر أنواع البيانات حساسية.

رأي الخبراء في التريند الجديد

وقد أكد خبير تكنولوجيا المعلومات السيد “محمد عزام”: تكمن الخطورة الأساسية، في أن المستخدمين يقدّمون صورهم ومعلوماتهم الشخصية بأنفسهم، لتدخل مباشرة في أنظمة ذكاء اصطناعي تستخدم هذه البيانات للتعلّم والتطوير، وزيادة قدرتها على التحليل والتوقّع مستقبلاً.

كما يؤكد السيد عزام، خبير تكنولوجيا المعلومات، أن الاندفاع وراء هذه الصيحات التكنولوجية يغيب عنه الوعي الرقمي. ويشير إلى أن “تغذية الخوارزميات ببيانات حقيقية وبكميات ضخمة يرفع من كفاءة الذكاء الاصطناعي في محاكاة البشر بشكل مرعب، مما يطرح تساؤلات أخلاقية كبرى حول ملكية هذه البيانات ومدى مشروعية استخدامها في تدريب نماذج قد تُستخدم مستقبلاً في مجالات المراقبة أو التلاعب بالرأي العام”.

من جانبه، يوضح السيد محمد إبراهيم، خبير أمن المعلومات في حديثه لقناة الجزيرة (مصر)، أن الضمانات التي تقدمها التطبيقات بحذف الصور بعد فترة زمنية محددة هي غالباً “وعود تسويقية” تفتقر للرقابة.

ويضيف إبراهيم: “لا توجد وسيلة تقنية للمستخدم العادي للتأكد من مسح البيانات نهائياً. بمجرد رفع الصورة، تصبح متاحة للاطلاع أو الاستخدام في بيئات رقمية غير خاضعة للرقابة، مما يفتح باباً خطيراً لانتهاك الخصوصية والتعرض لعمليات الابتزاز الرقمي أو انتحال الشخصية”.

أخلاقيات الذكاء الاصطناعي تحت المجهر

عالميًا، تتزايد علامات الاستفهام حول أخلاقيات استخدام الذكاء الاصطناعي، خاصة عندما يتعلق الأمر بالصور الشخصية.، فالأمر لا يتوقف عند حدود المستخدم نفسه، بل يمتد لانتهاك خصوصية الآخرين، فالمستخدم قد يرفع صورة لصديق أو طفل دون علمه، مما يضع بيانات هؤلاء الأشخاص في يد شركات تقنية كبرى دون موافقتهم.

عالمياً، تتصاعد التحذيرات بشأن أخلاقيات الذكاء الاصطناعي، حيث أصبحت الصور الشخصية مادة دسمة لإنشاء “التزييف العميق” (Deepfakes)، وهو ما يشكل تهديداً مباشراً للأمن والسلم المجتمعي، ويفتح الباب أمام استغلال غير مشروع للصور.

هل تُحذف الصور من تقنيات AI

رغم أن العديد من التطبيقات تؤكد أن الصور تُحذف بعد فترة زمنية محددة، إلا أن هذا الادعاء يظل غير مضمون، فلا توجد وسيلة حقيقية لدى المستخدم للتأكد من عدم الاحتفاظ بنسخ من هذه الصور أو إعادة استخدامها لأغراض أخرى، ويكفي أن نذكر بأن هناك تسريبات ومصادر تتحدث على أن تطبيق المراسلة الفورية واتساب لا يحمي الخصوصية ويمكنه التجسس على محادثاتك على الرغم من تأكيد شركة (ميتا) أن خصوصية المستخدمين محفوظة ولن تُنتهك.

وقد حذّر خبير أمن المعلومات محمد إبراهيم قائلًا:

“أي صورة يتم رفعها إلى منصة رقمية يمكن نظريًا الاحتفاظ بنسخة منها أو إعادة استخدامها، خاصة في حال غياب الشفافية. هذا يشكّل خطرًا حقيقيًا، لأن الصور قد تُستغل لاحقًا في انتحال الهوية أو التحليل غير المصرّح به”.

كيف تحمي نفسك دون الانعزال عن التطور؟

لحماية نفسك من مخاطر تريند الكاريكاتير وأدوات الذكاء الاصطناعي، دون أن تنقطع عن التطور الرقمي، يمكن اتباع مجموعة من استراتيجيات ذكية وواقعية، وإليك بعض النصائح والإرشادات:

- تجنب رفع صورك الشخصية الحقيقية، خصوصًا صور الهوية أو صور تظهر أماكنك أو أشخاصًا تعرفهم.

- استخدم صور رمزية أو رسوم كرتونية قبل المشاركة، بدلًا من الصور الأصلية.

- قبل استخدام أي تطبيق ذكاء اصطناعي، تحقق من كيفية حفظ الصور، ومدة الاحتفاظ بها، وحقوق الاستخدام.

- تجنب التطبيقات التي لا توضح سياسة حذف البيانات أو التي تمنحها لنفسها الحق في الاحتفاظ بالصور.

- قلّل مشاركة معلوماتك الشخصية مع التطبيقات والخدمات.

- لا تربط حساباتك الشخصية مباشرة مع الأدوات الجديدة دون وعي كامل بالنتائج المحتملة.

- اعتمد على منصات معروفة وموثوقة في مجال الذكاء الاصطناعي، ويفضل أن تكون لها سجل شفاف في حماية البيانات.

- تحديث التطبيقات دائمًا لأن النسخ الحديثة غالبًا تصحح الثغرات الأمنية.

- فكر قبل رفع أي صورة: هل هناك خطر محتمل للخصوصية أو استخدام الصورة بطريقة غير مناسبة؟

- تذكر أن أي صورة تُرفع يمكن أن تُحفظ أو تُحلل أو تُستغل لاحقًا.

- تابع التريندات واستخدم أدوات الذكاء الاصطناعي للتجربة والمعرفة وزيادة ربح المال من الإنترنت، لكن دون كشف هويتك الحقيقية.

- استخدم صورًا عامة، أو رمزية، أو مولّدة بواسطة الذكاء الاصطناعي لتجربة التريند دون تعريض خصوصيتك للخطر.

الخلاصة

قد يبدو تريند الكاريكاتير بالذكاء الاصطناعي مسليًا وبريئًا، لكنه في الواقع يحمل مخاطر حقيقية تمس الخصوصية والأمان الرقمي. ويحذّر الخبراء من الانسياق وراء التريندات دون وعي، مؤكدين أن صورة واحدة قد تكون كافية لفتح باب يصعب إغلاقه لاحقًا. الوعي الرقمي اليوم لم يعد خيارًا، بل ضرورة، لهذا كن حذراً ولا تكن سلعة رخصية في يد تقنيات الذكاء الاصطناعي التي قد تلحق بك أضراراً في المستقبل.

**********************************